Accumu Vol.5

音声コミュニケーションの脳内メカニズム 人工知能が言葉を理解するためには

京都大学総合人間学部自然環境学科助教授 京都コンピュータ学院講師 松村 道一

物理的振動から神経情報へ

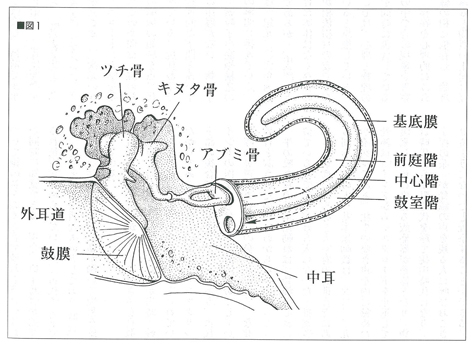

図1 鼓膜と蝸牛管の構造。音声振動は外耳道から鼓膜に到達し,

3種類の小骨の振動を介在して,リンパ液に満たされた蝸牛管に伝えられる。

蝸牛管は,かたつむりのようにぐるぐると2回半巻いている。

この図では,簡略化のため引き伸ばしてある。この蝸牛管の中は,

先端部ほど広くなっていて,ラッパのような管になっている。

この中心部にある中心階に,聴覚神経が存在しているのである。

Kandel「Princeples of Neural Science」より

ヒトのコミュニケーションの仲立ちは,言わずと知れた言葉である。文字の発明は人類の歴史上かなり後のことであるので,ヒトの脳の情報処理に革命をもたらしたのは,話言葉が中心であると考えられている。いわゆる阿吽(あうん)の呼吸と呼ばれるものや,目と目でわかるコミュニケーションというものが存在するのも確かではあるが,今回の話のテーマは,耳から聞こえてくる話し声だけに限ることにしたい。

音声は,勿論空気中を伝わる振動として伝播される。その音が鼓膜に入り,かたつむりのような形をした蝸牛管に伝えられて,神経情報に翻訳されるわけである(図1)。この物理量が神経情報に変換される過程を,もう少し詳しく説明してみよう。

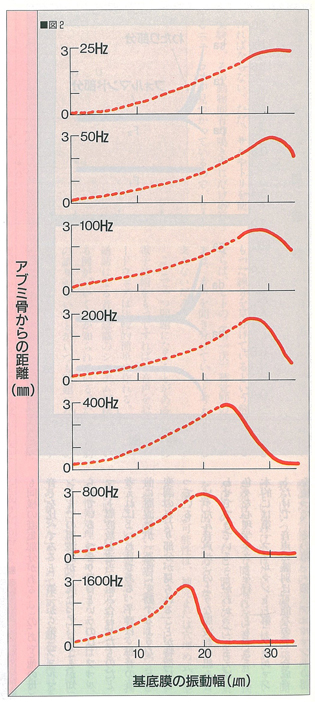

図2 最も大きく振動する基底膜の部分と,音の周波数との関係。

周波数が低いときには,蝸牛管の先端部分の基底膜が最大の振幅を示し(最上部),

周波数が高いときには,アブミ骨に近い部分の基底膜が,最も強く振動する(最下部)。

周波数の情報が,蝸牛管内の位置情報に変換されていることがわかる。

Kandel「Princeples of Neural Science」より

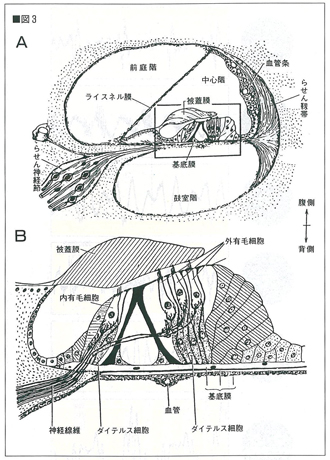

蝸牛管は真っすぐに引き伸ばすと,末広がりのラッパのような管になっていて,中はリンパ液で満たされている。空気中を伝わってきた振動エネルギーは,ここで液体の振動に変換される。金管楽器と同じように,特定の周波数の音は,この管の特定の位置に最もよく振動する部分を作り出す(図2)。この振動が起こっている部分に存在する特別な細胞(有毛細胞)の毛が震え出すと,詳しいメカニズムは省略するが,その細胞にパルス様の活動電位が発生するのである(図3)。

つまり,特定の周波数の振動が,まず蝸牛管の特定の位置の情報に変換される。そして今度は,その位置にある神経細胞を駆動するのである。そうすると,蝸牛管の神経細胞は,ある特定の周波数にだけ応答しているということができる。ちなみにこの神経細胞が発生するパルス電位の頻度は,周波数ではなくて音の強さを表現することになる。通常の音は,単一周波数(つまり純音)とは違い,色々な周波数が混じっている。その周波数に応じて色々な神経細胞が同時に活動するので,言うなれば蝸牛神経は,スペクトルアナライザーのような働きをしているのである。

図3 蝸牛管の断面図。A:中心階に,振動を受ける基底膜が存在する。

B:Aの四角で囲った部分を,さらに拡大してある。

被蓋膜と接触している有毛細胞の毛の部分が,振動によって変型すると,

この細胞にパルス状の活動電位が発生する。

入来・外山「生理学」より

音声の認知機構

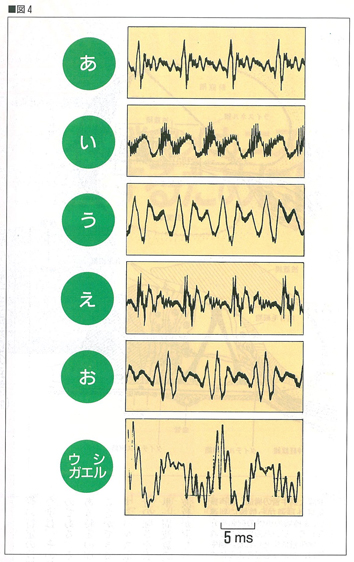

図4 音声のオシロスコープ像。

上から順に,「あ」「い」「う」「え」「お」,

「ウシガエルの鳴き声」

そもそも音声というのは,他の音とどのように区別されているのだろうか。また音響工学的にどのようにとらえ得るのだろうか。音の情報を視覚化する一番簡単な方法は,マイクロフォンでとらえた音声を,オシロスコープでモニターしてみることである。何やら複雑な波形が得られるが,この波形は,音声以外のものとどう区別がつくのか,また音声同士でどう区別がつくのか,残念ながらこのままでは見極めようがない(図4)。

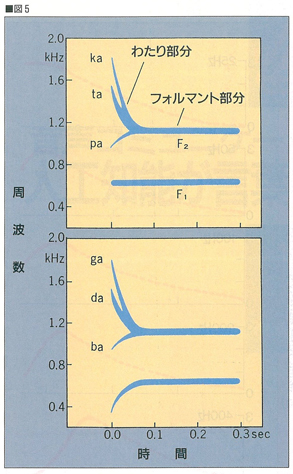

図5 音声のソナグラム。

音声は,周波数が定常状態に保たれている「フォルマント部分」と,

それに先立つ「わたり部分」とから成り立っている。

フォルマント部分が母音を決定し,

周波数変調のあるわたり部分が子音を決定している。

入来・外山「生理学」より

いったんこの波形をフーリエ変換し,時間毎に変動するその波長成分を一目でわかるように表示したのが,ソナグラムである(図5)。

ソナグラムは,縦軸に周波数,横軸に時間をとり,ある特定の周波数のエネルギーの値を,インクの濃さで表している。「あ」という母音は,690Hzの前後に一固まりのエネルギー凝集部分があり(これを第1フォルマントという),次に1170Hz(第2フォルマント),2570Hz(第3フォルマント)の周波数帯にも同様の凝集部分がある。この「あ」と他の母音とを比べてみると,第1から第3フォルマントまでの周波数が,異なっていることが知られている。つまり母音というのは,フォルマント周波数を適当に組み合わせたものだと考えればよいわけである。子音は,母音の直前に周波数が一過性に変動するような,FM変調のわたり部分が見られることが特徴になっている。

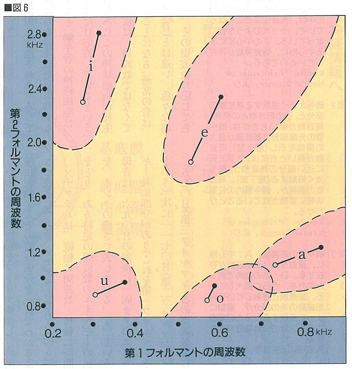

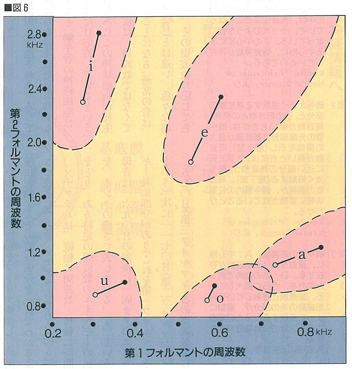

いったん音声がこのような周波数の組み合わせでできていることがわかってしまえば,色々な心理学テストを行うこともできる。基本的には第1フォルマントと第2フォルマントだけで,音声の識別は可能なので,合成音を使って,その第1・第2フォルマントの周波数を変えてやると,それに応じて聞こえる母音の種類が変わってくる。(図6)には,アメリカ人の母音の聞き取り領域を示してある。「あ」とも「お」とも聞こえる領域があるのは,大変面白いことである。

図6 ある特定の母音を識別できる,第1フォルマントと第2フォルマントの領域。

白丸は男性の平均,黒丸は女性の平均。

「a」と「o」は,どちらとも聞こえる部分がある。

入来・外山「生理学」より

蝸牛管から出た神経線維は,脳に入り色々な中継核を経て,大脳皮質聴覚野に投射している。中継核というのは,単に音情報を中継しているだけではなくて,左右の音を聞き分けたり,位相のずれを利用して音源の方向を言い当てたりするような機能を持っている。しかし今回の音声の認識機構の話とは,直接関係がないので省略する。聴覚野には,このような音声に対して特異的に応答するニューロンがあると考えられている。直接ヒトの脳に電極を刺して,そのようなニューロンが存在するかどうか今のところ調べる技術がないので,あくまでも推論であることをお断りしなければならない。ただ,サルやトリを使った実験で,その動物固有の鳴き声にだけ応答するニューロンが見つかっているので,ヒトにもその固有の音声に応答するニューロンが存在することは,十分に予想できるのである。第1次視覚野のニューロンが,特定の傾きをもった線分を見分けているという解釈をするならば,ヒトの(第1次)聴覚野のニューロンは,音声を聞き分けていると考えても差し支えないだろう。

ここで一つ問題になることがある。現代の電子技術をもってすれば,音声を認識するハードウェアは比較的簡単に作れる。実際に,通話による音声認識のシステムが稼働している例が,いくつか知られている。ただし判別の誤りが多いことがいつも問題になるのである。これは人によって声色が違うというような,単純な問題ではない。ハードウェアの精度がいかに向上しても,この誤りはいかんともし難いのである。

根本的な問題は,ヒトがいつも正確に発音記号どおりの発音をしているわけではないことにある。前後の言葉につられて,あいまいな発音をしていることの方が多いのである。時には,別の音声の範疇に入ってしまうこともある。先程も述べたように,正常な発音をしていても,「あ」と「お」には重なる部分があるのである。初めて習う外国語が非常に聞き取りにくいのも,ここに問題の一端がある(図7)。この問題の解決のためには,1音節ごとの分析だけでは不十分なのである。

図7 日本人の耳には,フランス語はどう聞こえているか。

心理学テストによる明瞭度の違い。

左:5種類の日本語母音を聞き分けたときの判別能力を,

統計的な距離として,XY座標にプロットしてある。

お互いの距離が遠い程,明確に判別できたことを示している。

右:8種類のフランス語の母音に対する,同様の統計的距離。

日本人には,「e」と「ε」の違いが,ほとんど判別できないことがわかる。

小嶋(1986)より

ウェルニッケの言語野と言語情報処理

つまり一つの音節が分析できたことだけでは,言語が理解できたことにはならないのである。いくつかの音節が集まって,初めて意味のある言葉になるのは当然のことであるが,我々はいつもクリアで正確な言葉の発音を聞いているわけではない。それでは,あいまいな発音やノイズで聞き取れない音声から,我々はどのようにして間違いのない正しい言葉を選び出すのであろうか。

第一の可能性は,補完または穴埋め式のやり方である。「_ンピュータ」というあいまいな発音を聞いた途端に,我々は直ちに「コンピュータ」という言葉を思い浮かべるだろう。我々の脳は,わからない部分があるからといって,情報処理をやめてしまうわけではないし,あいまいな部分に関していちいち五十音順に「あ」から「ん」まで当てはめて,順番に検討をしているわけでもない。あらかじめ言葉として成り立ち得る答を用意して,脳は待ち構えているのである。言うなれば,パターン照合のような作業をしているのである。この辺りは,最近のワープロのスペルチェッカーのような機能と似ていると考えれば,聴覚野で行われている言語処理の機能も理解しやすいのではなかろうか。この場合は,できあがった文章を後からチェックするのではなくて,オンラインの処理である。最近はやりのニューラルネットの技術でも,この辺の問題はどうにかクリアできるようである。

しかし例えば「れい_うこ」であれば,これは「冷蔵庫」か「冷凍庫」かすぐには判定がつかない。第二の可能性というのは,明らかに文脈に依存するやり方である。この言葉の前後で話されている内容によって,初めて言葉が一意的に決定されるのである。ここまでくると,言葉の貯蔵庫から引っ張り出してきた単語とのマッチングだけでは間に合わない。言葉と言葉をつなぐ構文(文法)と,その意味内容が重要になってくる。

この辺りの情報処理を担うのは,ウェルニッケの言語野と呼ばれる領域であり,90%のヒトでは左半球の側頭部に存在する。5%は右半球,残りの5%は両半球に言語野がまたがっている。この偏りは,利き手に関係していると言われている。左利きの人は,右半球に言語野をもつことが多く,成長の過程で右利きに矯正された人は,言語野が両半球にまたがって存在することが多い。

脳梗塞や脳出血でこのウェルニッケの言語野に傷害が起こると,音は聞こえているのに,言葉の意味がわからない,という障害が生じることが知られている。PET(ポジトロン・エミッティング・トモグラフィ)と呼ばれる装置で脳の活動を調べてみると,朗読を聞いているときには,明らかに左半球のウェルニッケ言語野が活動していることがわかる。また音楽を聞かせると,右半球に活動が偏るのも面白い現象である。

ごく最近の研究で,正常な人のウェルニッケ言語野や,後で述べるブローカ言語野に,1cm間隔で電極を埋め込み,電気刺激をするという実験が行われた。色々な言語テストをしている間に電気刺激を与えると,言語機能が障害されるが,その障害は刺激部位ごとに少しずつ異なっていた。つまり一口に言語野と呼ばれている広い領域にも,少なくとも1cm2位の単位で,少しずつ機能の異なったモジュール構造がある,ということがわかってきたのである。

言葉の意味とメタ認知

言語は,書かれていることがすべての情報ではない。俗に「行間を読む」・「眼光紙背に徹す」と言われているが,言葉というものはいくらでも深読みができるのである。比喩で語られていたり,その言葉から何となく連想がわいてきたり,一つの文が二重の意味にも三重の意味にも読めることがある。例えば次のような不完全な文があったとする。

1 ぶらぶら_んぽ

2 くろい_んこ

解読をすると,1の答はもちろん「ぶらぶら散歩」,2は「黒いあんこ」または「黒い金庫」であるが,1と2の文が並んでいると,何となく他の連想をしてしまいそうな気がするから,言葉とは不思議なものである。

俳句は5・7・5の17文字から成り立っているが,これは俳句には17バイトの情報しかないということではない。「古池や」という1節だけで,我々の頭の中には古池のビジュアルイメージが広がり,この句を読んでいる人の生活体験に従って,様々な連想や感情がわいてくるのである。それだけでも,5バイトをはるかに上回っていることは間違いない。ましてやそれに続く12文字の意味を組み合わせると,とてつもなく広大な詩的空間が現れてくるのである。

このように,言語は単なる情報伝達のメディアであるわけではなくて,我々の精神状態の意味的(Semantics)再構成を創り出す手段として利用されているのである。言うなれば,言葉の解読作業の上に立って,そのすべての意味を理解しようとしている意識が,脳のどこかに存在するということだろう。これをメタ認知と呼ぶ人もあるし,平たく言えばこれが知性そのものであるわけである。

一般的に情報処理の過程を眺めていると,処理されるデータには,入口があって出口があるという,極めてすっきりした体系が存在している。しかしどんな処理体系でも,すっきり理解できるとは限らない。処理される言語に眼を奪われて,情報の入口から出口まで,言葉の行く末だけを追い求めているとしたら,こんなメタ認知の存在には永遠に気が付かないだろう。そんな研究者には,単に情報として処理されていくデータより,一段高いところに位置する知性の存在が,眼に入らないからである。

残念ながらこのメタの情報処理を行う脳の領域は,まだ解明されていない。脳の中には低次の情報処理をする領域から,高次の処理をする領域まで,色々な階層性があることがわかってきている。すべての感覚情報は,最終的に大脳皮質連合野に到達することがわかってきたので,そこで最も高次の情報処理が行われていると推測することも可能である。勿論この領域が知性そのものかどうかは,検討の余地が残っている。脳は典型的な分散処理のシステムであるので,この連合野を破壊したところで,知性そのものを目の前に取り出すことはできないのである。

今世紀最大の数学者と言われているゲーデルは,「ある公理系からできあがった世界には,証明することも否定することもできない定理が必ず存在する」ことを証明してしまった。これはゲーデルの不完全性定理と呼ばれており,この難解な定理を,一般化してもう少し砕いて説明すれば,「どんな立派な理論を作っても,その理論からは証明できない対象が必ず存在する」ということになろうか。

だとすれば,ニューロンの機能をもって脳の機能を説明しようとしても,説明不可能な事態が生じ得るわけである。科学というものが,徒労に終わる可能性もあるのである。同じことは人工知能の研究についても言えるのであって,メタレベルの処理は,低レベルのプログラム言語では処理できないことになるかもしれないのである。コンピュータ技術の中で,将来とも一番厄介な課題が,このメタ認知の問題であろう。プログラムを自動的に作るソフトウェアを開発しようとしても,誰がその業務を監督し采配するのかという問題を,解決しないといけないわけである。この「全能の神様」は,自動化ソフト自身の中にいるわけもなく,ましてやOSがそのようなものに関知しているはずはないだろう。計算機科学の一番奥底は,いまだに謎のままである。

言語の発声とブローカの言語野

勿論音声コミュニケーションは,「聞く方:ヒアリング」だけでは成り立たない。もう一つ大事な「話す方:スピーチ」の要素がある。脳の中でもこの二つは分業していて,話す時はもっぱら前頭葉の「ブローカ」の言語野という領域が働いている。このブローカの言語野も,ウェルニッケの言語野と同じく,大多数の人で左半球優位である。

このブローカの言語野でも,ウェルニッケの言語野に勝るとも劣らない,複雑な機能が営まれているのであるが,残念ながら紙面が尽きてしまったので,この話はいずれまたの機会に譲ることにしよう。

言語の情報処理は,ヒトの脳の最も発達した機能であるが,まだまだその実体はよくわかっていない。その解明のためには,言語認知の機構の研究や,神経科学のさらなる進展が望まれる。最後に,この方面の研究について,もっと知識を得たいという人には,次の本を推薦しておきたい。

「脳とコミュニケーション」(シリーズ脳の科学)岩田 誠著 朝倉書店

「人工知能と人間」長尾 真著 岩波新書